情報は記録され、時間という川を遡る。人類は数千年にわたり、石版に文字を刻み、磁気ディスクに電子の並びを焼き付けることで、静的な「状態」を固定し保存し続けてきた。しかし、量子力学の領域において、変化のプロセスそのものである「演算」を捕獲し、後から好きなタイミングで再生するという試みは、直感に反するほどの困難を伴う。

量子状態は一度の観測で不可逆な変化を被り、未知の物理法則のブラックボックスを無傷のままコピーすることは許されない。未知のプログラムをメモリに留め置き、任意の瞬間に実行を引き出す「量子演算の保存と再生(Storage and Retrieval)」。この壮大な技術的課題において、東京大学の吉田智治助教、宮崎慈生特任研究員、村尾美緒教授らの研究チームは、量子メモリを用いた情報の保存が、従来の古典的なメモリを根本から凌駕することを数学的に証明し、物理学界に新たな地平を開いた。

演算を凍結せよ。量子プログラムが直面してきた古典の壁

未知の演算を保存し、再生するというタスクは、レシピが明かされていない料理を何度も味わって作り方を逆算し、それをメモに書き残して後日再現する作業に似ている。情報科学の世界において、任意の未知の演算を有限のリソースで完璧に再現することは不可能であるという「ノー・プログラミング定理」が、1997年にMichael Nielsenらによって示されている。研究者たちはこの絶対的な制約を回避するため、近似的な手法や確率的なアプローチを用いて演算の保存を試みてきた。

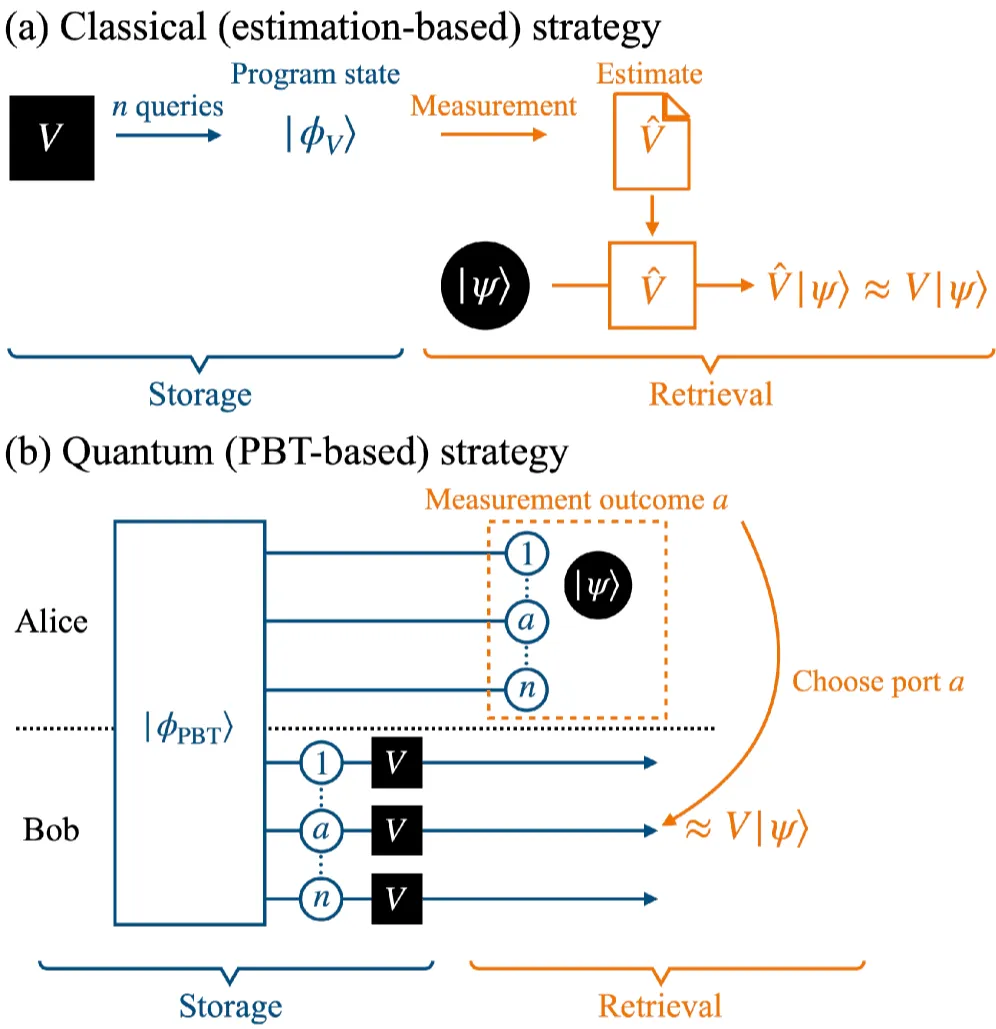

これまでの量子情報科学において、情報の総量が変化しない可逆的な操作である「ユニタリ演算」を対象とした場合、この「味見とメモ(推定と古典メモリへの記録)」のプロセスが、あらゆる戦略の中で最も優れていると信じられてきた。具体的には、未知のユニタリチャネルを幾度となく呼び出し、入力と出力の変化を観測して行列要素を古典的なビット列(0と1のデータ)へと変換する手法である。

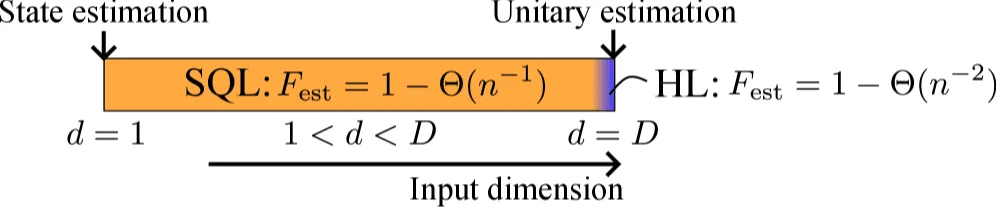

興味深い事象はここから始まる。ユニタリ演算を対象とする限り、最先端の量子メモリを用いて演算を量子もつれの中に直接封じ込める「量子戦略」を用いても、古典的な推定戦略に対する優位性は見出せなかったのである。ユニタリ推定は、入力と出力の両方に完全にアクセスできるという恵まれた条件を活かし、「ハイゼンベルク限界(HL)」と呼ばれる極めて高い精度向上率を達成できる。すなわち、呼び出し回数を増やすほど誤差は呼び出し回数の二乗に反比例して急速に縮小していく。結果として、量子力学特有の複雑なメモリを構築する労力に見合うだけの恩恵は得られず、「未知の演算の保存には、古典メモリで十分である」という強固なパラダイムが形成されていた。

しかし、この前提はあくまで情報の次元が一切増減しないという狭い条件の上に築かれた城に過ぎない。現実の量子アルゴリズム、たとえば特定解を高速に探索するGroverのアルゴリズムや、外部環境との相互作用をモデル化する量子誤り訂正においては、補助的な量子ビットを追加し、情報はしばしばより高次元の広大な空間へと埋め込まれる。この操作は「アイソメトリ演算(等長写像)」と呼ばれ、ユニタリ演算とは明確に異なる幾何学的性質を持つ。次元の壁を越えるこの広範な演算に対しても、果たして古典のメモ帳は万能なのだろうか。

アイソメトリの深淵と、標準量子限界という絶対の鎖

アイソメトリ演算は、小さなキャンバスに描かれた絵を、広大な壁画の一部として歪みなくシームレスに組み込むような操作である。入力された量子状態の性質を保ちながら出力の次元を拡張するこの一見すると単純な操作が、演算の推定というタスクにおいては致命的な暗闇を生み出す。

量子情報における「スタインスプリングの表現定理」によれば、ノイズや情報の散逸を伴うあらゆる一般的な量子操作(量子チャネル)は、失われる情報を含めた巨大な環境空間を仮想的に用意し、その全体系における純粋なアイソメトリ演算として再解釈できる。つまり、アイソメトリの振る舞いを制することは、ノイズを含むすべての量子演算を制することと同義である。

吉田教授らのチームは、このアイソメトリ演算を古典的に推定する際の限界を数学のメスで解剖した。彼らが導き出した定理1によれば、アイソメトリ演算の推定忠実度(推定の正確さを示す指標 $F$)は、 という数式に支配される。ここで、$n$ は演算を呼び出した回数(クエリ複雑性)、$d$ は入力の次元、$D$ は出力の次元を示す。

この数式が突きつける現実は冷酷である。誤差を減らすためには、呼び出し回数 $n$ に反比例してしか精度が向上しない。これは「標準量子限界(SQL)」と呼ばれる物理学の壁であり、どれだけ味見の回数を増やしても味覚の解像度が遅々として上がらないことを示している。

ユニタリ演算の推定がハイゼンベルク限界の恩恵を受けていたのとは対照的に、アイソメトリ演算においては入力次元 $d$ よりも出力次元 $D$ が大きいという条件が加わった途端、出力空間における未知の部分空間が隠された死角となり、推定の効率が急激に失速してしまう。研究チームは、この標準量子限界の鎖を完全に解き明かし、推定に基づき古典メモリへと保存する戦略が根本的な限界を抱えていることを初めて明白にした。

もつれが切り開く二次的飛躍のメカニズム

古典的なメモ帳が限界を迎えるとすれば、我々は情報の保存をどう最適化すればよいのか。ここで登場するのが、量子もつれという宇宙で最も神秘的な結びつきを応用した「ポートベース・テレポーテーション(PBT)」戦略である。

PBTとは、送信者(Alice)と受信者(Bob)の間で複数の「ポート(出入口)」となる量子もつれのペア群をあらかじめ共有し、対象となる未知の演算と共同で測定を行うことで、演算そのものを遠隔地や未来のメモリの中へと転送する技術である。このアプローチの最大の真価は、未知の演算の中身を理解しようとしない点にある。料理のレシピを推測するのではなく、厨房ごとタイムカプセルに閉じ込めて未来へ送るような発想である。

研究チームは、このPBTベースの量子戦略を用いた場合、所望の近似誤差(ダイヤモンドノルム誤差 )を達成するために必要な演算の呼び出し回数が になることを導き出した。古典戦略で同じ誤差を達成するには 回の呼び出しが必要となる。

この数式の違いは圧倒的な現実の違いをもたらす。たとえば近似誤差を100分の1に抑えたいと考えたとき、古典戦略では100倍の呼び出し回数が必要になるのに対し、量子戦略ではわずか10倍の労力で到達できる。これこそが、長年待ち望まれていた「量子メモリの優位性」の厳密な証明である。アイソメトリ演算の保存と再生において、量子メモリは古典メモリに比べて二次的(平方根)な効率化を達成し、演算回数の壁を打ち破る構造的優位性を確立したのである。

現実空間の量子クラウドに与える構造的インパクト

この理論的ブレイクスルーが社会と学術界にもたらす影響は、実験室の枠をはるかに越える。現代のテクノロジー産業において、高度な計算資源はクラウド上で共有されるアーキテクチャが主流となっている。将来の量子クラウドコンピューティング環境において、ソフトウェア開発者は独自の量子アルゴリズムをブラックボックスとして提供し、ユーザーはそれを自らの秘匿データに適用したいと考えるだろう。

もし古典戦略を用いて演算を保存しようとすれば、ユーザーは提供された演算を無数に呼び出し、アルゴリズムの全貌を推定して丸裸にしてしまう危険性がある。しかし、PBTを用いた量子戦略では演算の正体を解明することなく、ただ純粋な量子状態として保存し、非同期で再生することができる。これはソフトウェアの知的財産権を保護しながら高度な演算能力を安全に提供する「ブラインド量子計算」の実現において、決定的なセキュリティ基盤を提供する。

さらに、研究チームはこの手法を最も一般的な量子操作(CPTP写像)の普遍的プログラミングへと拡張した。プログラムを保存するために必要となる量子状態のサイズ(プログラムコスト)について、先行するGschwendtnerらの研究結果では $2Dd^2 \log \Theta(\epsilon^{-1})$ のリソースが必要とされていたのに対し、今回の新手法ではそれを $\frac{Dd^2 - 1}{2} \log \Theta(\epsilon^{-1})$ へと、最大で約75パーセントも削減するという圧倒的な効率化を達成している。ノイズに脆弱な近未来の量子デバイス(NISQ)やその次の世代のハードウェアにおいて、複雑な量子回路をより少ない量子ビットで保持できることは極めて実践的な価値を持つ。

現在のところ、ポートベース・テレポーテーションやコヒーレンスを長期間維持する量子メモリは、少数の量子ビットを用いた基礎的な概念実証の段階にある。明日にでもデータセンターに導入される技術ではない。しかし、量子誤り訂正技術の進展やハードウェアのスケールアップのペースを鑑みれば、今後5年から10年の間に、特定のアルゴリズムに特化した小規模なブラインド量子計算ネットワークがクラウド上で稼働し始める公算が大きい。今回の理論的な証明は、その未踏のアーキテクチャが構築される際、どの程度の量子リソースを投資し、どのような戦略を採用すべきかを決定する厳密な設計図となる。

未解明のフロンティアと残された問い

量子メモリが古典メモリを明確に打ち破る瞬間を証明した本研究は、同時に新たな未踏の地を我々の前に提示している。本研究が対象としたのは、未知のチャネルを「1回」だけ再生する単一コピーのタスクである。しかし、現実の複雑なアルゴリズムのサブルーチンにおいては、保存した演算を複数回連続して呼び出したいという要求が必ず発生する。

古典メモリに保存されたデータであれば、それを何度コピーして使っても問題は生じない。しかし、量子力学の支配下においては、未知の量子状態を完全に複製することは物理法則が禁じている(ノー・クローニング定理)。複数のコピーを再生するタスクにおいて、古典戦略の再利用性と量子戦略のもつれ消費がどのように交差し、どちらが最終的な優位を保つのか。また、古典戦略のみに制限した際の最適なプログラムコストについての予測(本研究内で示された Conjecture S9)の完全な証明は、未来の研究者に委ねられている。

演算という動的な変化そのものを結晶化し、未来へ送る。この難解で美しい挑戦は、人類が量子力学の真の力を飼い慣らし、次世代の情報インフラを築き上げるための壮大な歴史の新たな1ページとして深く刻まれる。