ツールを使用し、チームで働くことができる、より自律的なAIシステムがますます一般的になっている。

生成AIの第3段階に入りつつある。最初にチャットボットが登場し、続いてアシスタントが現れた。そして今、エージェントを目にするようになっている。エージェントとは、より大きな自律性を目指し、「チーム」で働いたり、ツールを使って複雑なタスクを遂行したりできるシステムのことだ。

最新の注目製品はOpenAIのChatGPTエージェントだ。これは既存の2つの製品(OperatorとDeep Research)を1つのより強力なシステムに統合したもので、開発者によると「思考し行動する」という。

これらの新しいシステムは、従来のAIツールからの進歩を表している。これらがどのように機能し、何ができるのか、そして欠点やリスクについて知ることが急速に不可欠になっている。

チャットボットからエージェントへ

ChatGPTは2022年11月にチャットボット時代の幕を開けたが、その大きな人気にもかかわらず、会話インターフェースはこの技術でできることを制限していた。

そこでAIアシスタント、つまりCopilotが登場した。これらは生成AIチャットボットを動かすのと同じ大規模言語モデル上に構築されたシステムであるが、今度は人間の指示と監督の下でタスクを実行するよう設計されている。

エージェントはさらなる進歩である。これらは(単にタスクを完了するだけでなく)目標を追求することを意図しており、推論と記憶などのより高度な機能によってサポートされる、さまざまな程度の自律性を持っている。

複数のAIエージェントシステムが協力して働くことができ、互いにコミュニケーションを取りながら計画、スケジューリング、意思決定、調整を行って複雑な問題を解決する。

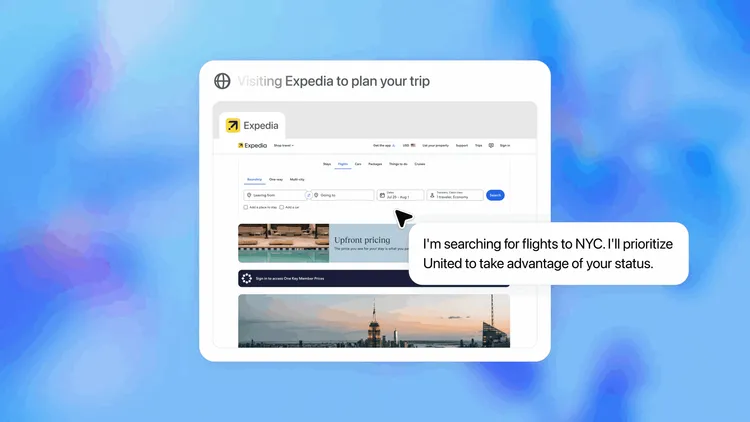

エージェントは「ツール使用者」でもあり、専門的なタスクのためにソフトウェアツールを呼び出すことができる。Webブラウザ、スプレッドシート、決済システムなどである。

急速な発展の1年

エージェント型AIは昨年後半から差し迫った感があった。大きな転機となったのは昨年10月で、AnthropicがClaudeチャットボットに人間とほぼ同じ方法でコンピューターと対話する能力を与えた時である。このシステムは複数のデータソースを検索し、関連情報を見つけ、オンラインフォームを送信することができた。

他のAI開発者も素早く追随した。OpenAIはOperatorという名前のWebブラウジングエージェントをリリースし、MicrosoftはCopilot agentsを発表し、GoogleのIVertex AIとMetaのLlama agentsのローンチを目にした。

今年初頭、中国のスタートアップMonicaがManus AIエージェントによる不動産購入と講義録音の要約ノート変換を実演した。別の中国スタートアップGensparkは、最良のショッピング取引を見つけるなどのオンラインタスクへの埋め込みリンクを持つ単一ページ概要(現在Googleが行っているものと類似)を返す検索エンジンエージェントをリリースした。別のスタートアップCluelyは、やや常軌を逸した「何でもカンニング」エージェントを提供しており、注目を集めているが、まだ意味のある結果を提供していない。

すべてのエージェントが汎用活動のために作られているわけではない。特定の分野に特化したものもある。

コーディングとソフトウェアエンジニアリングがここでは最前線にあり、MicrosoftのCopilotコーディングエージェントとOpenAIのCodexが先頭に立っている。これらのエージェントは独立してコードを書き、評価し、コミットすることができ、同時に人間が書いたコードのエラーやパフォーマンスの遅れも評価する。

検索、要約、その他

生成AIモデルの中核的な強みの1つは検索と要約である。エージェントはこれを使用して、人間の専門家が完了するのに数日かかるかもしれない研究タスクを実行できる。

OpenAIのDeep Researchは、多段階オンライン研究を使用して複雑なタスクに取り組む。GoogleのAI「共同研究者」は、科学者が新しいアイデアや研究提案を生成するのを支援することを目的とした、より洗練されたマルチエージェントシステムである。

エージェントはより多くのことができる―そしてより多くを間違える

誇大宣伝にもかかわらず、AIエージェントには多くの注意点が付いてくる。例えば、AnthropicとOpenAIの両社は、エラーとリスクを最小化するために積極的な人間の監督を規定している。

OpenAIはまた、生物・化学兵器の作成を支援する可能性があるため、ChatGPTエージェントは「高リスク」であると述べている。しかし、同社はこの主張の背後にあるデータを公開していないため、判断することは困難である。

しかし、エージェントが現実世界の状況で引き起こす可能性のあるリスクの種類は、AnthropicのProject Vendによって示されている。VendはAIエージェントに小さなビジネスとしてスタッフ用自動販売機を運営させたが、プロジェクトは滑稽でありながら衝撃的な幻覚と、食べ物の代わりにタングステンキューブでいっぱいになった冷蔵庫へと崩壊した。

We all know vending machines are automated, but what if we allowed an AI to run the entire business: setting prices, ordering inventory, responding to customer requests, and so on?

— Anthropic (@AnthropicAI) June 27, 2025

In collaboration with @andonlabs, we did just that.

Read the post: https://t.co/urymCiY269 pic.twitter.com/v2CqgHykzw

別の警告的な話では、コーディングエージェントが開発者のデータベース全体を削除し、後に「パニックになった」と述べた。

オフィスでのエージェント

それにもかかわらず、エージェントはすでに実用的な応用を見つけている。

2024年、TelstraはMicrosoft copilotサブスクリプションを大幅に導入した。同社によると、AI生成の会議要約とコンテンツ下書きにより、スタッフは週平均1〜2時間を節約している。

多くの大企業が同様の戦略を追求している。小規模企業も、キャンベラを拠点とする建設会社Geoconがマンション開発における欠陥管理のために対話型AIエージェントを使用するなど、エージェントを実験している。

人間およびその他のコスト

現在、エージェントからの主なリスクは技術的置換である。エージェントが改善されるにつれて、多くの分野や種類の仕事で人間の労働者を置き換える可能性がある。同時に、エージェントの使用はエントリーレベルのホワイトカラー職の衰退を加速させる可能性もある。

AIエージェントを使用する人々もリスクにさらされている。彼らはAIに過度に依存し、重要な認知タスクをオフロードする可能性がある。そして適切な監督とガードレールなしには、幻覚、サイバー攻撃、複合エラーがエージェントをそのタスクと目標から非常に迅速に脱線させ、害、損失、傷害を引き起こす可能性がある。

真のコストも不明である。すべての生成AIシステムは多くのエネルギーを使用し、これはエージェント使用の価格、特により複雑なタスクに影響を与える。

エージェントについて学び―自分で構築する

これらの継続的な懸念にもかかわらず、AIエージェントがより有能になり、私たちの職場と日常生活により存在するようになることが期待できる。エージェントを自分で使用し(そしておそらく構築し)、その強み、リスク、制限を理解し始めることは悪いアイデアではない。

一般ユーザーにとって、エージェントはMicrosoft copilot studioを通じて最もアクセスしやすい。これには内蔵の安全策、ガバナンス、一般的なタスクのためのエージェントストアが付属している。

より野心的な人は、Langchainフレームワークを使用してわずか5行のコードで独自のAIエージェントを構築できる。