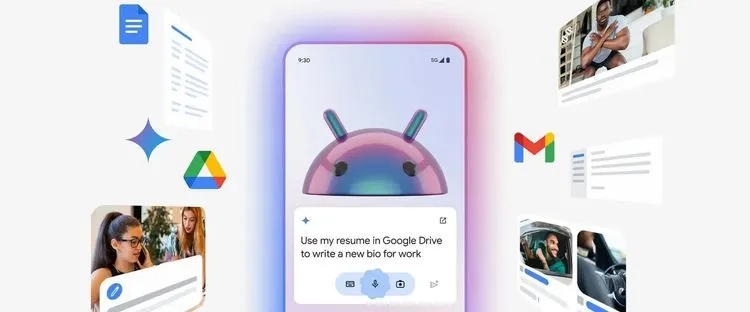

Google I/Oを翌週に控えた2026年5月13日、同社は「The Android Show: I/O Edition」と題したイベントで、Androidの新たなAI機能群の総称として「Gemini Intelligence」を正式発表した。Googleはこの発表をアシスタント機能の延長として位置付けていない。Androidそのものを「オペレーティングシステムからインテリジェンスシステムへ」移行させるという、プラットフォームとしての大規模な方向転換を宣言した。

GeminiがOSのレイヤーに統合される意味

従来のGeminiは、ユーザーが呼び出す「アシスタント」という位置付けにとどまっていた。しかしGemini Intelligenceが目指すのは、ユーザーの操作を常に先読みし、アプリをまたいだタスクをオートメーション化するエージェント型の統合だ。Googleはこれを「ハードウェアとソフトウェアの深い統合」と表現しており、デバイスそのものがユーザーのニーズを先取りするインフラとして機能することを想定している。

これは、OpenAIやAnthropicが推進するAIエージェント競争においてGoogleが放つ回答でもある。実際、Googleは2026年5月初旬に実験的なブラウザエージェント「Project Mariner」を終了させ、その技術を新しい「Gemini Agent」へと統合したばかりだ。Gemini Intelligenceの発表はその延長線上にあり、競合他社との差別化をモバイルOSレイヤーで実現しようとする意図が読み取れる。

初期の展開対象は最新のSamsung Galaxy端末とGoogle Pixel端末に限定され、今夏から提供開始となる。年内にはスマートウォッチ、自動車、AR/XRグラス、ラップトップへと対応デバイスを拡大する予定だ。

マルチステップ自動化:アプリをまたいで動くエージェント

Gemini Intelligenceの核となる機能が、アプリを横断した多段階タスクの自動実行だ。このタスク自動化機能は、2026年3月にGalaxy S26とPixel 10向けに先行提供が開始されていた。当初はDoorDashやUberなど、フードデリバリーとライドシェアに限定した試験運用だったが、Googleはその後数ヶ月間かけてシステムの精度を磨いてきたと説明している。

具体的なユースケースとして、Googleが挙げるのはこのような場面だ。ノートアプリに記載した買い物リストを長押しで選択し、Geminiに「これをデリバリーカートに追加して」と指示すると、Geminiはショッピングアプリを自動的に操作してカートを構成する。あるいは、ホテルのロビーで見かけた旅行パンフレットを撮影し「Expediaでこれに似たツアーを6人分探して」と言えば、Geminiがバックグラウンドで検索・予約フローを進め、最終的な決済確認だけをユーザーに委ねる。

画面の内容をリアルタイムで読み取り、それをコンテキストとして利用できる点が従来の音声アシスタントとの大きな違いだ。電源ボタンの長押しでGeminiを起動すると、その時点で表示されている画面がそのままインプットになる。ユーザーは切り替え操作なしに、見ている情報に基づいたアクションをGeminiに指示できる。

ただし、自動化が機能するのは対応アプリに限られる。現状では食料品注文やライドシェアが中心で、任意のアプリを自動操作できるわけではない。それ以外のウェブベースのタスクに対しては、Chrome経由のアプローチが用意されている。

Chrome on Android:WebブラウジングにもGeminiが介入

「Auto Browse」機能がデスクトップ版Chromeに登場してから数ヶ月、2026年6月末にはAndroid版Chromeにも同機能が展開される。対象はAndroid 12以上のすべてのデバイスだ。

Gemini in Chromeは、ウェブページの内容を要約したり、ページにまたがる情報の比較や調査を支援したりする。Auto Browse機能は、予約や駐車場確保といった定型的なウェブ上の手続きをGeminiが代行する。ただしデスクトップ版Auto Browseは速度と精度の面で評価が分かれており、Googleも改善を続けている段階だ。クラウドベースのGeminiモデルを活用することで、モバイル最適化されたシンプルなページではデスクトップ版より実用的に動作する可能性はあるが、複雑なページへの対応は引き続き課題として残る。

インテリジェント・オートフィル:GeminiがAndroidのフォーム入力を変える

Androidのオートフィル機能も、Geminiの「Personal Intelligence」と接続されることで大きく変わる。従来の氏名・住所・メールアドレスといった静的なデータの補完にとどまらず、車のナンバープレートや特定状況に応じた情報を動的に埋め込む方向へと進化する。

GboardのサジェストバーにGeminiのスパークアイコンが表示され、そこからオートフィルを実行できる。この機能は明示的なオプトインが必要であり、設定からいつでも無効化できる。プライバシーへの配慮を明確にした設計は、欧州などの規制環境を意識したものとも受け取れる。

Rambler:人間の話し方に合わせた音声入力

Gemini Intelligenceのなかでユーザーの日常に最も直接的に影響するのが、Gboardに統合された「Rambler」機能だ。音声入力は長年にわたって「話した言葉をそのまま文字にする」という一対一の変換にとどまっていたが、Ramblerが採用するのは文字通りの書き起こしではなく意図の抽出だ。Geminiのマルチリンガルモデルを活用し、フィラーワードや発話の揺らぎを処理したうえで、整形されたテキストとして出力する。

具体的には、買い物リストを音声で作成中に「りんごはやっぱりいらない」と言えば、Gboardはその意図を理解し、最終的なリストからりんごを除外する。複数言語を混在させた発話にも対応しており、英語とヒンディー語を同一メッセージ内で混在させても文脈とニュアンスを正しく捉えるとGoogleは説明している。

Gboard上で動作するため、AndroidのすべてのアプリでRamblerが利用可能になる。音声データは文字起こし中のみ処理され、音声もテキストも保存・保持されない。入力中はGemini Intelligenceの新デザイン言語に沿ったウェーブフォームがキーボード全幅に表示され、Ramblerが稼働中であることをユーザーに明示する。

iOSでは4月に「Google AI Edge Eloquent」として同様の機能が実験的に提供されていた。Ramblerはそれをシステムレベルに統合し、Android全体で利用可能にした実装と位置付けられる。

Create My Widget:言葉でウィジェットをヴァイブコーディング

生成UIの切り口でGemini Intelligenceが提示するのが「Create My Widget」だ。ウィジェットはAndroidの歴史と共に歩んできた機能だが、今回は自然言語でウィジェットそのものを生成できる。

ユーザーはウィジェットピッカーの「作成」ボタンをタップし、欲しいウィジェットの内容をプロンプトとして入力する。「毎週3つの高タンパク質ミールプレップレシピを提案して」と入力すれば、カスタムのダッシュボードウィジェットが生成され、ホーム画面に追加・リサイズが可能になる。「風速と雨量だけを表示した天気ウィジェットが欲しい」という絞り込んだ要求にも対応する。

生成されるウィジェットはRemoteComposeという新しい基盤フレームワーク上に構築されており、スナップスクロールや表現力の高いボタン、パーティクルエフェクトなどのUIコンポーネントをサポートする。Wear OS向けタイル(Tiles)にも同機能が展開される——Apple Watchとの競争が続くスマートウォッチ市場において、AIが生成するパーソナライズドタイルはWear OSの差別化要素になりうる。プリセットカテゴリとして、天気アラート、世界時計、デイリーブリーフ(占い・レシピ・名言)、イベントカウントダウン、株式・暗号資産価格などが用意されている。

このアプローチは、Nothing社が昨年独自に投入した類似ツールとの競合になる。ただしGoogleの強みはエコシステムの規模にあり、Geminiモデルの精度と既存アカウントデータへのアクセスが品質の鍵を握る。

Material 3 Expressiveとインテリジェンスデザイン言語

Gemini Intelligenceには、新しいビジュアルデザイン言語も伴う。Material 3 Expressiveをベースに、GeminiがいつリスニングしているのかThinkingしているのかWorking中なのかを視覚的に示す共通のアニメーション体系が定義されている。

Ramblerのウェーブフォームもその一部だ。Googleはこのビジュアルシステムを「美しいだけでなく機能的」と説明し、「目的を持って動くことで、散漫さを減らしユーザーの集中をサポートする」としている。このデザイン言語はGemini Intelligenceが搭載されるすべての機能に一貫して適用される。

開発者への影響:AppFunctionsとRemoteCompose

Gemini Intelligenceはエンドユーザー向けの機能だけでなく、開発者向けのAPIも拡充する。「AppFunctions」はアプリが持つ機能群をOSとエージェントに公開するためのインターフェイスで、Model Context Protocol(MCP)に類似した設計思想を持つ。

KakaoTalkとの早期テストでは「メッセージを送る」「音声通話を開始する」といったアプリ内アクションをGeminiから直接トリガーできることを実証済みだ。現在25のアプリのユースケースがデバイスメーカーをまたいでローカル実行に対応しており、Early Access Programへの参加登録が開始されている。

Jetpack Glanceによるウィジェット開発では、RemoteComposeへの移行がAndroid 16以上で自動的に行われ、旧バージョンへの後方互換性も維持される。フォルダブル、タブレット、Android Auto対応車両(2億5000万台)、XR HMDへのアダプティブ対応も同時に強化されている。

Androidが「エージェントOS」になる現実

Gemini Intelligenceの発表は、スマートフォンの使い方についての前提を塗り替えようとするものだ。タスクの実行をユーザーが主導するのではなく、デバイスが先読みして代行する——この方向性はOpenAIのOperator、AnthropicのComputer Useと同じベクトルを向いている。

一方でGoogleがAndroid上に展開することで生まれる固有の優位性は、OSレベルでの深い統合にある。GboardはAndroid全体で動作し、Autofillはシステムレイヤーで機能する。アシスタントアプリとしてではなく、OSの一部として動作するGeminiは、サードパーティのAIエージェントが追随しにくい領域を確保する。さらにApple Intelligenceとの構造的な差異として、GoogleはSamsungやSonyといったOEMパートナーシップを通じて、自社製Pixelデバイス以外のAndroid端末にもGemini Intelligence機能を展開できる。Apple Intelligenceが自社製品のみを対象とするのと対照的で、展開速度よりもスケールを重視した戦略だ。

ただし課題も残る。タスク自動化の対応アプリは食料品注文やライドシェアなど限定的な領域にとどまっており、短期的なユーザー体験を左右する要因となる。Google I/O 2026では、Gemini Intelligenceのさらなる詳細と、デスクトップやXRデバイスへの統合ロードマップが明らかになるとみられる。