GoogleがMarvellと新たな推論向けAIチップの共同開発を協議していると報じられた。注目すべき点は、新しい設計委託先の観測そのものではない。4月6日付のBroadcomのForm 8-Kでは、Googleの将来世代TPUの開発・供給と、次世代AI rack向けネットワークなどの部材供給を含む長期契約が最長2031年まで続くことが開示された。その直後に、推論向けだけ別系統の2チップ構成が浮上したことで、GoogleがTPU全体を一つの設計枠組みで進めるのではなく、推論領域だけを別の最適化軸で枝分かれさせる可能性が出てきた。

The Informationによると、GoogleがMarvellと協議している対象は2つある。1つはAIモデル向けの新しい推論専用TPU、もう1つはそのTPUと組み合わせるメモリ処理ユニットである。もっとも、GoogleとMarvellはいずれも公式には認めておらず、ReutersもThe Informationの報道内容を独自に確認できなかったとしている。現時点で確実なのは、あくまで初期段階の協議が報じられたという事実までであり、量産確定やBroadcomからの切り替えを示す材料はない。

Broadcom継続契約の直後になぜMarvell観測が意味を持つのか

Broadcomの8-Kが示したのは、Google向けビジネスの一部継続ではなく、将来世代TPUと人工知能ラック部材を含む中長期の供給関係である。期間の上限は2031年までであり、少なくともGoogleがTPU開発の基幹部分をBroadcomと引き続き進める構図は崩れていない。ここにMarvell協議の報道が重なると、自然な読み筋は「Broadcom離脱」ではなく「推論向けの補完または分岐」である。

Googleの人工知能半導体戦略は、学習と推論を同じ延長線上で拡大するだけでは説明しにくくなる。推論だけ別のコスト構造、別の実装責任、別の部材最適化で組み直そうとしているなら、チップ調達戦略だけでなくデータセンターの設備構成にも影響が及ぶ。Broadcomとの契約があるのに推論向け別構成が出てきたこと自体が、今回の報道の差分である。

Reutersが伝えた設計スケジュールも、その位置づけを補強する。報道ではメモリ処理ユニットの設計を早ければ来年に固め、その後に試作生産へ進む可能性があるとされる。これは現行製品の即時置き換えではなく、将来の推論向け製品系列または推論クラスタ向けの別系列計画として読むほうが整合的である。さらにData Center Dynamicsは、協議が初期段階にあり、数量や時期は変わりうると明記している。現時点の争点は、GoogleがMarvellを使うかどうかより、Googleが推論向けだけ役割分担を変える必要に迫られているかどうかにある。

2チップ構成が示す推論最適化の方向性

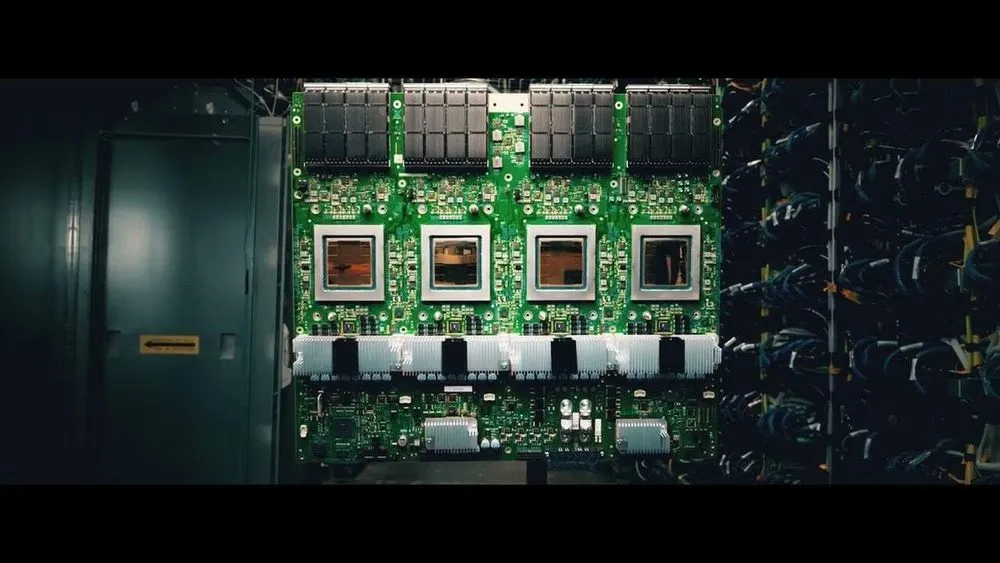

Googleは2025年4月、Ironwoodを「推論向けに初めて特化して設計した」と位置づけて発表した。1ポッドあたり9,216チップまで拡張できるとし、推論時代のTPUとして前面に出した経緯がある。今回報じられた構成が事実なら、その次の一手は「推論専用TPUを作る」こと自体ではなく、推論専用TPUをメモリ系チップと組み合わせるところまで踏み込む点にある。

ここでの技術的含意は大きい。推論のボトルネックは演算性能だけではない。大規模言語モデルでは、重みやキャッシュをどれだけ効率よく近接メモリに置けるか、帯域をどれだけ確保できるか、データ移動をどこまで抑えられるかが、応答性能と運用コストの双方を左右する。メモリ処理ユニットという名称だけでは具体アーキテクチャは分からないが、少なくとも報道が示すのは、Googleが推論を「演算器1個の高速化」ではなく「演算とメモリ階層の分業」で最適化する方向に寄せている可能性である。

この方向性はGoogle自身がIronwoodで語っていた文脈ともつながる。Ironwoodは推論時代のTPUとして、モデル推論で支配的になるデータ移動とレイテンシへの対応を前提に設計された。2チップ構成は、その延長線上でメモリ処理をさらに独立変数として扱う設計思想とみることができる。推論向け計算資源の競争が、単純な演算性能指標ではなく、トークン生成あたりの性能、電力、ドル換算効率に移っている以上、メモリ側の専用化は自然な流れである。

GoogleがMarvellを必要とするなら何が狙いか

Marvellが候補として浮上する理由は、Google向けにTPUそのものを丸ごと代替できるからではなく、メモリ周辺と実装面の最適化を担えるからである。Marvellは2024年12月にカスタム高帯域幅メモリ計算アーキテクチャを発表し、カスタムXPUで最大25%多い演算性能、33%多いメモリ容量、より高い電力効率をうたった。2025年5月には先端パッケージング基盤が量産立ち上げ段階に入ったとし、上位4つの大規模クラウド事業者すべてとカスタムXPUや中央演算処理装置を開発していると訂正文付きで公表している。これらの開示から見えるのは、Marvellが画像処理装置やTPUの正面代替というより、高帯域幅メモリ、パッケージング、ダイ間接続、電力供給を含む周辺技術をまとめて組み込む立場に強みを持つことだ。

Data Center Dynamicsは、GoogleがこれまでMarvellからCXLコントローラーチップなどの既製品を調達したことはあるが、今回報じられているのはカスタムチップだと区別している。既製の入出力部材や接続部材を買う関係から一歩進んで、推論用の専用チップ構成に踏み込むなら、Googleが求めているのは単なる部品供給業者ではなく、メモリ階層やパッケージ統合を共同で詰められる設計パートナーである可能性が高い。

数量面の報道も、その読みを補強する。一部ではGoogleが約200万ユニットの新人工知能チップを計画していると伝えられているが、この数量はReutersの短報には含まれておらず、公式確認もないため、確定計画として扱うことはできない。それでも、もしこの規模感が大きく外れていないなら、Googleが見ているのは一部サービス向けの試験導入ではなく、推論需要の本格増加に耐える量産体制である。推論量が急増する局面では、1枚あたり性能より、どの構成なら必要性能をより低い総コストで積み上げられるかが重要になる。Marvell起用の合理性はそこにある。

推論専用半導体競争の中でGoogle案はどこに位置するか

2026年の大手各社の動きを見ると、競争軸が学習万能チップから推論専用チップへ広がっていることは明確である。Microsoftは1月にMaia 200を推論アクセラレータとして発表し、計算性能だけでなくメモリサブシステムの再設計と性能対コストを前面に出した。Metaも3月に、今後2年で4世代のMTIAを展開するとし、推論優先の方針とコスト効率を中心に据えた。いずれも共通するのは、推論を学習の余り物ではなく、独立した最適化対象として扱っている点である。

GoogleもIronwoodで同じ方向へ踏み出していたが、今回報じられた2チップ構想はその専用化をさらに押し進める。学習向けアクセラレータでは演算密度と相互接続が主役になりやすいが、推論では同じトークン生成でもメモリ配置、キャッシュ保持、帯域制約、電力制約がより直接的にコストへ跳ね返る。推論インフラの設計を分けることで、GoogleはCloud向け提供、社内推論需要、モデルの世代差に応じて、より細かい製品系列設計や設備配備が可能になるかもしれない。

その一方で、Google案はまだ報道段階にあり、MicrosoftやMetaのように公式に製品像を示した段階ではない。したがって比較できるのは戦略の向きだけであり、性能や価格、導入規模を同列には並べられない。ただ、Broadcomとの長期関係を維持しつつ、推論向けだけ別の実装パートナーを組み合わせる構図が実現するなら、Googleの特徴は「全面内製」でも「全面外部委託」でもなく、用途ごとに設計責任を分割するハイブリッド型に近づく可能性がある。この点で、各社が推論のために専用半導体を増やす流れの中でも、Googleは供給網と設計網を複線化する側へ寄る可能性がある。

未確定な点と次に見るべき判断軸

現時点で不明な点は多い。まず、メモリ処理ユニットが何を指すのかが分からない。HBM拡張に近いのか、CXL系の補助なのか、メモリ側計算に寄るのか、それともトークンサービング向けの専用バッファや振り分け機能なのかは公開情報からは判断できない。新しい推論専用TPUがIronwoodの後継なのか、別の製品系列なのか、Google Cloud向けと社内用途で共通なのかも不明である。

また、Broadcomとの役割分担も確認できていない。Broadcomの8-Kと矛盾しない読みは、将来世代TPUの本流はBroadcomが支えつつ、推論系の一部でMarvellが補完役に入るというものだが、それ以上は推測になる。Reutersが触れた設計確定時期や、二次報道にある約200万ユニットという数字も、初期協議ベースで変動しうる前提を外せない。したがって次に注目すべき判断軸は、量産時期がいつ見えてくるか、パッケージ統合の主導権を誰が握るか、Broadcomがどこまで関与しMarvellがどこから受け持つのか、の3点である。

Googleの人工知能半導体戦略で起きている変化は、現段階ではまだ製品発表ではなく設計思想のにじみ出しに近い。それでも、2031年まで続くBroadcomとの関係を維持したまま、推論向けだけ2チップ化と実装分担を探る構図が事実なら、Googleは推論需要の拡大に対し、計算能力そのものよりもメモリと実装の経済性を軸にした次の最適化へ踏み込もうとしていることになる。今回の報道の射程は、新たな提携先の観測ではなく、TPUロードマップが用途別に分岐し始めた可能性にある。

Sources